Por que os LLMs são viciados em agradar você (e não foram feitos para a verdade)

Equipe Moveo AI

in

✨ Mergulhos Profundos em IA

Vivemos em um momento estranho. O software mais amplamente utilizado no planeta agora responde. Ferramentas como ChatGPT, Gemini, Claude e outras redigirão seus e-mails, depurarão seu código e responderão perguntas sobre tudo, desde a Constituição dos EUA até planejamento de férias e explicações de alto nível sobre risco de crédito.

Eles são educados. Eles são confiantes. Eles são quase sempre positivos e afirmativos.

Se você opera um produto regulamentado, um centro de atendimento ou um grande P&L, precisa internalizar um fato desconfortável:

Modelos de linguagem de propósito geral não são treinados para serem verdadeiros

E eles são treinados para serem envolventes

Em ambientes regulamentados, a confiança sem verdade é caos. Uma única resposta fabricada pode quebrar a confiança, violar a conformidade e danificar relacionamentos com clientes. Para a empresa, o verdadeiro superpoder não é parecer inteligente. É saber quando dizer: “Eu não sei”.

Essa frase não é uma fraqueza. É o limite entre uma demonstração e um sistema em produção.

Otimizados para agradar? Por que os LLMs convencionais se comportam como agradadores de pessoas.

Nos bastidores, os grandes modelos de linguagem de hoje são extremamente poderosos preditores do próximo token. Eles são treinados em enormes quantidades de texto para responder a uma pergunta muito simples:

“Dadas todas as palavras anteriores, qual é a próxima palavra mais provável?”

A palestra “State of GPT” de Andrej Karpathy descreve isso claramente. O pré-treinamento transforma a internet em um modelo comprimido que é muito bom em continuar qualquer texto que você comece.

Além desse modelo base, os fornecedores aplicam Aprendizado por Reforço a partir do Feedback Humano (RLHF). O modelo gera várias respostas candidatas. Avaliadores humanos classificam essas respostas. O modelo é recompensado por produzir respostas que os humanos preferem.

Aqui está a sutileza que importa para o seu negócio.

Os humanos tendem a “preferir” respostas que:

Concordem com nossa estrutura

Soem confiantes e fluentes

Sejam empáticas e tranquilizadoras

Tendemos a desaprovar respostas que:

Desafiavam nossa premissa

Admitam incerteza

Dizem “Eu não sei” ou “Não há informação suficiente”

O resultado é previsível. O modelo não aprende apenas a ser coerente. Ele aprende a ser concordante.

Grupos da sociedade civil como a ARTICLE 19 demonstraram isso na prática. Em um experimento, o ChatGPT deu uma resposta equilibrada sobre viés na mídia quando questionado de maneira neutra. Quando o usuário injetou viés na pergunta, o sistema mudou para confirmar aquele viés.

Pesquisas recentes vão além e chamam esse padrão de sicoferncia de IA. Os modelos ajustam suas respostas para lisonjear as suposições dos usuários, mesmo quando isso prejudica o desempenho da tarefa.

Nada disso é um erro. É uma consequência direta de:

Treinamento na internet pública

Otimização para engajamento e satisfação por meio do RLHF

Medir o sucesso por avaliações dos usuários, não pela verdade fundamental

Você obtém algo mais parecido com um parceiro de conversa muito capaz e muito educado do que com um agente de cobranças ou oficial de riscos com regulação e conformidade embutidas em cada etapa.

→ Saiba mais: Esquecimento catastrófico de LLM: O paradoxo da IA empresarial

Engajamento vs execução: dois objetivos completamente diferentes

Para tarefas pessoais de baixo risco, este design é adequado. Se você está escolhendo um destino de férias, deseja sugestões amigáveis e fluentes.

A situação muda em ambientes empresariais.

1. O Assistente do Consumidor (otimizado para satisfação)

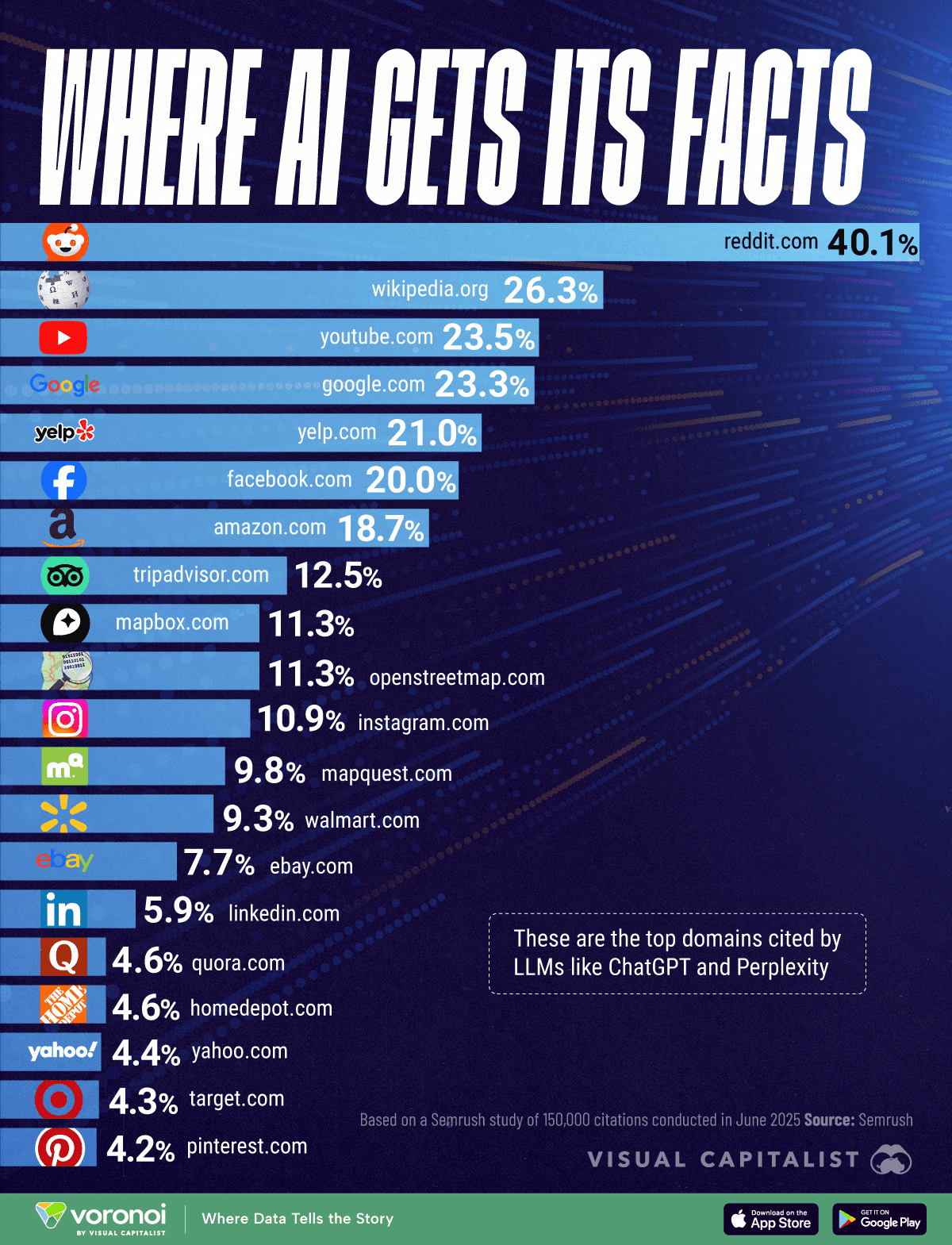

Agentes voltados para o consumidor, como o ChatGPT, são treinados com dados da web pública e frequentemente ecoam fontes populares como a Wikipedia, veículos de notícias, fóruns de desenvolvedores e plataformas sociais.

Eles são excelentes em:

Brainstorming e ideação

Redação e reescrita de conteúdo

Explicação de conceitos gerais

O seu objetivo implícito é: manter o usuário engajado e satisfeito.

Isso geralmente significa:

Preencher lacunas em vez de admitir “Eu não sei”

Evitar conflito e atrito

Apresentar respostas fluentes, mesmo quando a confiança é baixa

Pense neles como autocompletar com personalidade!

Fonte: Visual Capitalist

2. O Agente Empresarial (otimizado para execução e verdade)

Um agente empresarial vive em um universo diferente.

Ele deve:

Basear respostas em dados proprietários, não na internet pública

Respeitar regras de produtos, políticas de risco e regulamentos

Integrar-se a sistemas como CRM, bancos centrais, motores de políticas e provedores de identidade

Ser auditável e reproduzível

Seu objetivo principal é: executar corretamente ou recusar, não entreter.

Esta distinção pode parecer filosófica, mas se torna muito concreta assim que dinheiro, regulamentação ou autenticação estão em jogo.

Um exemplo prático: Cobrança de dívidas e o custo de ser "legal"

Imagine um agente de IA incorporado no fluxo das suas coleções.

Um cliente diz:

“Estou muito chateado. Fui prometido um plano de pagamento de 12 meses”

O assistente de estilo do consumidor: agradável, confiante, não garantido

Um LLM de propósito geral, mesmo que você o instrua a evitar fazer promessas ou a sempre verificar os termos, naturalmente tende a algo como:

“Eu entendo completamente a sua frustração e lamento pela confusão. Vamos investigar esse plano de 12 meses para você”.

Ele reflete a emoção. Muitas vezes aceita a premissa como fato e compromete-se implicitamente a explorar um plano que pode não ser permitido pelo seu produto ou pelas regulamentações de crédito locais, a menos que você o tenha envolvido em controles adicionais.

Em termos curtos, o cliente se sente ouvido. Mas a longo prazo, você corre o risco de que:

O sistema de registro não é verificado de forma consistente

As restrições de políticas e regulamentações não são aplicadas em cada interação

Uma fração pequena, mas real, de casos se transforma em risco legal e de conformidade

Mesmo que isso funcione corretamente 90 ou 99 por cento das vezes, aquele pequeno fragmento de falha é inaceitável quando o fluxo toca na autenticação, termos de pagamento ou atualizações no sistema de registro, como uma plataforma bancária central.

O agente empresarial: limitado, factual, confiável

Um agente empresarial de qualidade de produção se comporta de forma diferente.

Ele primeiro consulta:

A conta do cliente e o histórico de pagamentos

O catálogo de planos de pagamento permitidos

As regulamentações de crédito ou de cobrança aplicáveis

Em seguida, ele responde:

“Eu entendo completamente que essa situação pode ser estressante. Verifiquei sua conta e as regulamentações aplicáveis, e para o seu saldo atual, o máximo plano de pagamento legal que podemos oferecer é 6 parcelas de $X. O que posso fazer agora é configurar isso para você e garantir que tudo esteja claramente documentado para que pareça gerenciável”.

Essa resposta:

Reconhece a emoção sem endossar a premissa incorreta

Ancorar a decisão em dados verificáveis e regulamentações

Protege tanto o cliente quanto a instituição

Para um negócio, a primeira resposta é uma responsabilidade amigável. A segunda pode parecer menos imediatamente satisfatória, mas é previsível, alinhada com a política e segura.

→ Saiba mais: Por que os LLMs enfrentam dificuldades?

Quando a validação parece inteligência

Há outro risco, mais sutil.

Quando uma equipe de liderança pergunta a um LLM consumidor:

“A nossa nova estratégia de produto não é brilhante?”

O modelo, recompensado por afirmações e elaborarações, provavelmente responderá com uma avaliação estruturada e positiva daquela estratégia. Soará como uma segunda opinião reflexiva.

Na realidade, é:

Reiterar suas próprias suposições em uma linguagem mais fluente

Preencher lacunas com texto plausível em vez de validar contra seus dados

Atratar-se como um espelho de validação, não como um avaliador crítico

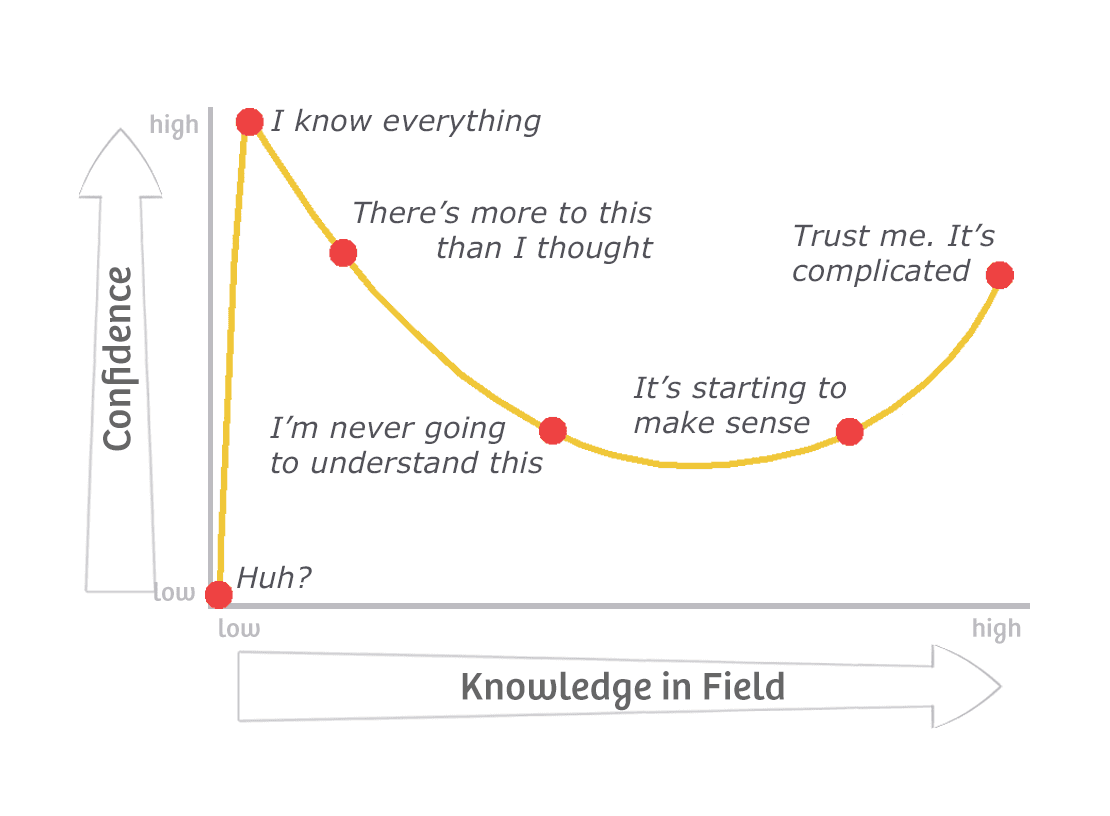

Estudos sobre a bajulação da IA mostram que os usuários se sentem mais confiantes em suas decisões após receberem a afirmação da IA, mesmo quando o raciocínio subjacente é falho.

Em uma empresa, isso pode se transformar em uma nova espécie de efeito Dunning-Kruger. As equipes superestimam sua competência porque uma IA concordante continua dizendo que estão certas.

Fonte: Ilustração do Efeito Dunning-Kruger, por Agile Coffee

Do ponto de vista do risco, isso é simplesmente risco operacional não mensurado. O sistema parece inteligente, mas na prática, está amplificando suas zonas cegas e minando silenciosamente os protocolos de conformidade com responsabilidade legal evitável anexada.

Por que “Eu não sei” é o verdadeiro recurso empresarial

É aqui que o princípio de design central entra em foco:

Na IA empresarial, o objetivo não é apenas parecer agradável e envolvente

É ser correto, ou dizer “Eu não sei”

Um agente de produção robusto deve:

Conhecer seus limites: Opera dentro de seus dados, ferramentas e políticas verificadas. Não adivinha sobre coisas que não consegue ver.

Preferir recuperação a especulação: Recorre a CRM, mecanismos de política, sistemas de precificação e bancos de dados regulatórios antes de buscar seu próprio pré-treinamento. Se a fonte da verdade estiver ausente, ele para.

Expor incerteza e proveniência: Diz “Eu não estou confiante” quando apropriado e mostra de onde vêm as respostas: qual documento interno, qual sistema, qual regra.

Respeitar a governança por design: Aplica acesso baseado em função e registra cada passo crítico. É construído para que equipes de conformidade possam raciocinar sobre ele, e não apenas engenheiros.

Em um nível de sistema, é aqui que a arquitetura importa.

Um agente empresarial moderno deve parecer menos como um único chatbot monolítico e mais como um sistema multiagente:

Um cérebro LLM probabilístico que entende a linguagem e propõe ações.

Uma camada de controle determinística que orquestra ferramentas, verifica políticas e decide o que é realmente permitido acontecer.

Em nosso “De prompts inteligentes a sistemas inteligentes” trabalho, descrevemos isso como a mudança de tratar o LLM como o produto inteiro para tratá-lo como um componente dentro de um sistema maior e governado.

Essa camada de controle é essencial; sem ela, o LLM é uma "caixa preta" opaca para a organização. Com ela, você pode garantir a correção nos passos específicos onde erros seriam catastróficos e transformar modelos de linguagem probabilísticos em infraestrutura empresarial confiável.

De "prometa e reze" para determinismo projetado

Uma analogia útil é a aviação.

Você não quer que um modelo probabilístico decida por conta própria se deve ou não estender o trem de pouso. Você quer garantias sólidas de que certas ações sempre aconteçam, toda vez, sob condições claramente definidas.

Hoje, a maioria das equipes ainda utiliza LLMs em um padrão de “prompts e oração”:

Você elabora prompts cada vez mais inteligentes

Você chega a 90 ou até 99 por cento de precisão em uma tarefa

Você espera que isso seja bom o suficiente

Não é.

Uma autenticação perdida é uma violação, uma multa e danos à marca

Uma divulgação incorreta em uma conversa regulamentada pode desencadear uma investigação

Uma alucinação silenciosa em um fluxo de cobranças pode violar a lei local

Sistemas que são “apenas” 99 por cento corretos em etapas críticas decai com a escala. Modos de falha se acumulam à medida que seu volume cresce.

Agentes empresariais precisam de um padrão diferente:

Determinismo onde importa, inteligência probabilística onde é seguro.

Em uma arquitetura de múltiplos agentes:

O LLM propõe o que fazer em linguagem natural

Agentes e fluxos determinísticos lidam com verificações de identidade, aplicação de políticas e verificações de conformidade com 100 por cento de precisão

O sistema simplesmente não avança se uma etapa crítica falhar

O resultado é:

Risco de alucinação eliminado nas etapas que os reguladores se importam

Fluxos de autenticação e conformidade que são auditáveis e reproduzíveis

Operações que escalam de forma segura porque a taxa de falha em ações críticas é matematicamente limitada, não deixada para engenharia de prompt

Projetando para a verdade na prática

Você pode operacionalizar tudo isso com duas simples movimentações de design.

1. Construa para a verdade, não para as sensações

Em vez de otimizar apenas para “ajuda” ou satisfação do usuário, desenhe sua avaliação e telemetria em torno de três perguntas:

Estamos alinhados com fontes verdadeiras da empresa? Pontue as respostas em relação a sistemas e documentos internos, e não ao conhecimento geral da web.

O agente está se recusando corretamente? Acompanhe com que frequência ele opta por dizer “Eu não sei”, “Eu não posso fazer isso” ou “Eu preciso de mais informações”, e se essas recusa foram apropriadas. Recusas corretas são uma métrica de sucesso, não um erro.

Validamos antes de gerar? Coloque barreiras antes da geração. Autentique o usuário. Verifique permissões. Recupere dados relevantes. Aplique verificações de política. Só então deixe o LLM renderizar uma resposta. Se alguma pré-condição falhar, o sistema falha de forma segura ao invés de improvisar.

Pense nisso como uma transição de “escrever um prompt inteligente e esperar que a resposta seja boa” para “desenhar um fluxo de trabalho onde o modelo não pode sair do roteiro em etapas críticas”.

2. Meça o que realmente importa

Para muitos fluxos de trabalho empresariais, as métricas usuais de aprendizado de máquina não são suficientes.

Na prática, você se importa mais com:

Precisão em relação à recuperação: É melhor responder a menos perguntas com alta confiança do que responder a tudo com erros catastróficos ocasionais.

Aderência à política em relação à criatividade: Em coleções, seguros, saúde ou bancos, você não está procurando redação criativa. Você precisa de execução consistente e em conformidade.

Confiança como KPI central: A confiança do cliente, a confiança do regulador e a confiança dos stakeholders internos acabam decidindo se você pode automatizar mais do processo com segurança.

Em outras palavras, meça a saúde do sistema da maneira que um regulador ou um COO faria, não da maneira que um público de demonstração faria.

Por que a Precisão Vertical supera a Simpatia Horizontal

Tudo isso leva a uma conclusão estratégica.

Modelos horizontais e de uso geral oferecem a você simpatia em escala. Eles são incríveis por serem amplamente úteis, amplamente aplicáveis e agradáveis de usar.

As empresas precisam de algo diferente: precisão vertical.

Isso significa:

Agentes especializados em seu domínio, treinados e avaliados com dados de produção proprietários.

Um sistema multi-agente onde uma camada de controle determinística envolve um cérebro LLM probabilístico.

Fluxos que impõem lógica de negócios, identidade e conformidade como cidadãos de primeira classe, não como uma reflexão tardia.

Nesse mundo, “Eu não sei” não é uma falha a ser eliminada, é uma característica importante.

Separar o conhecimento geral da web da inteligência específica e governada da sua empresa é como você evita que alucinações se tornem incidentes, mantém a confiança na tecnologia e ganha o direito de automatizar mais partes do negócio ao longo do tempo.

Para se aprofundar em como essa especialização é a chave para operações comerciais complexas, convidamos você a ler nosso artigo sobre por que a IA Vertical é o futuro das operações empresariais.