Se você está pensando em usar LLMs para automatizar suas operações de atendimento ao cliente, provavelmente está procurando respostas para perguntas como “É seguro usar ChatGPT? Ou “Posso usar LLMs hospedados de forma privada”. Sua busca termina aqui!

Este blog investiga as diferenças entre LLMs auto-hospedados e sistemas de terceiros como GPT-4 com foco em qualidade, segurança e personalização.

A revolução LLM

Large Language Models ou LLMs são modelos generativos de inteligência artificial, treinados em grandes quantidades de dados. Esses modelos são elaborados não apenas para compreender as complexidades da linguagem, mas também para responder contextualmente, criando uma experiência de conversação que imita a interação humana.

No ano de 2022, a OpenAI lançou o ChatGPT e o caos foi desencadeado! ChatGPT é o exemplo perfeito do que são LLMs e alterou completamente o cenário da IA. Muitos líderes de tecnologia seguiram o OpenAI, lançando seus próprios LLMs, como Google (Bard) e Facebook (Llama 2). Todos esses modelos abriram portas para novas possibilidades e aplicações, sendo os chatbots um dos mais destacados.

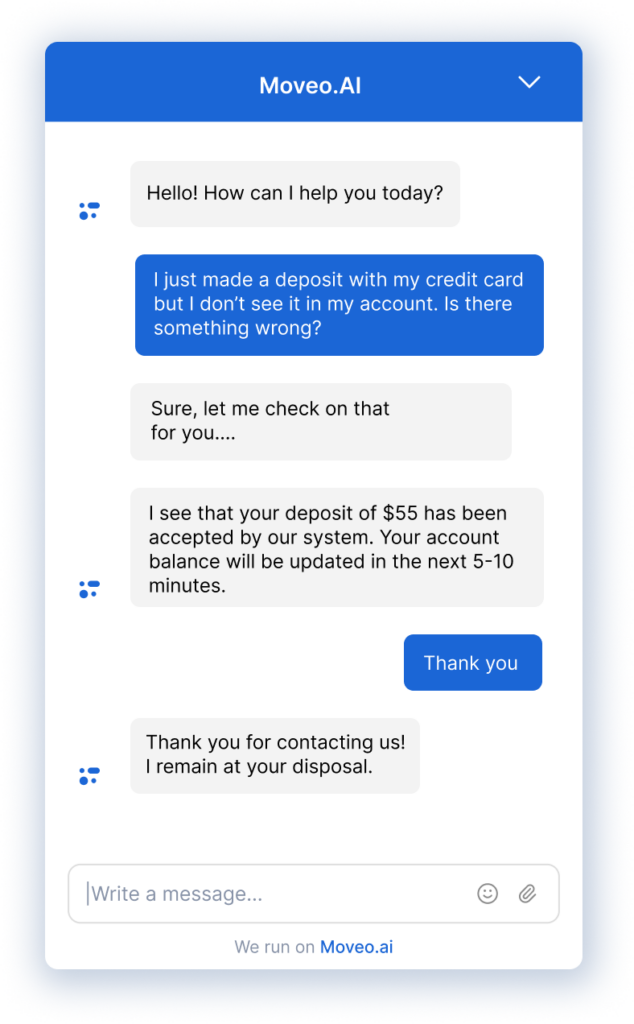

Os chatbots alimentados por LLMs podem ser alimentados com dados de negócios específicos e fornecer respostas instantâneas e semelhantes às humanas, 24 horas por dia, 7 dias por semana. No entanto, todos rapidamente perceberam que, embora impressionantes, o ChatGPT e o resto dos LLMs escondidos atrás de APIs não são a solução para tudo. Privacidade de dados, problemas de alucinação e incapacidade de fornecer respostas personalizadas em tempo real estão entre as maiores limitações.

Leia mais: Limitações do ChatGPT no atendimento ao cliente

The Open Source Approach: GPT-4 and beyond

LLMs such as GPT-4 are trained on billions of parameters, which makes them ideal for general use. However, the associated cost of training such models is enormous, making it almost impossible for smaller companies and AI labs to compete with tech giants. Como resultado, as empresas não tiveram escolha senão usar o GPT-4 e surgiram os chamados “invólucros GPT”. Essas empresas geralmente fornecem uma solução de chatbot, contando com uma integração de API com GPT-3.5 ou GPT-4 da OpenAI. Existem muitas razões pelas quais esta abordagem não é a ideal, mas as três principais estão listadas abaixo:

- Proteção de dados

Confiar dados sensíveis a plataformas baseadas na nuvem levanta preocupações válidas sobre a segurança dos dados, com potenciais implicações para a perda de propriedade intelectual. Esta preocupação estende-se ao potencial comprometimento de informações comerciais confidenciais e bancos de dados de clientes através de acesso não autorizado.

- Escalabilidade

Os detalhes técnicos do GPT-4, como o número de parâmetros e seus dados de treinamento, não foram divulgados, o que reforça a desconfiança e o ceticismo de muitas empresas em relação aos modelos de linguagem de código fechado. Embora o tamanho exato do GPT-4 não seja conhecido, é um modelo de linguagem muito grande, o que torna muito difícil escalar para muitas solicitações simultâneas e reduzir seus tempos de resposta.

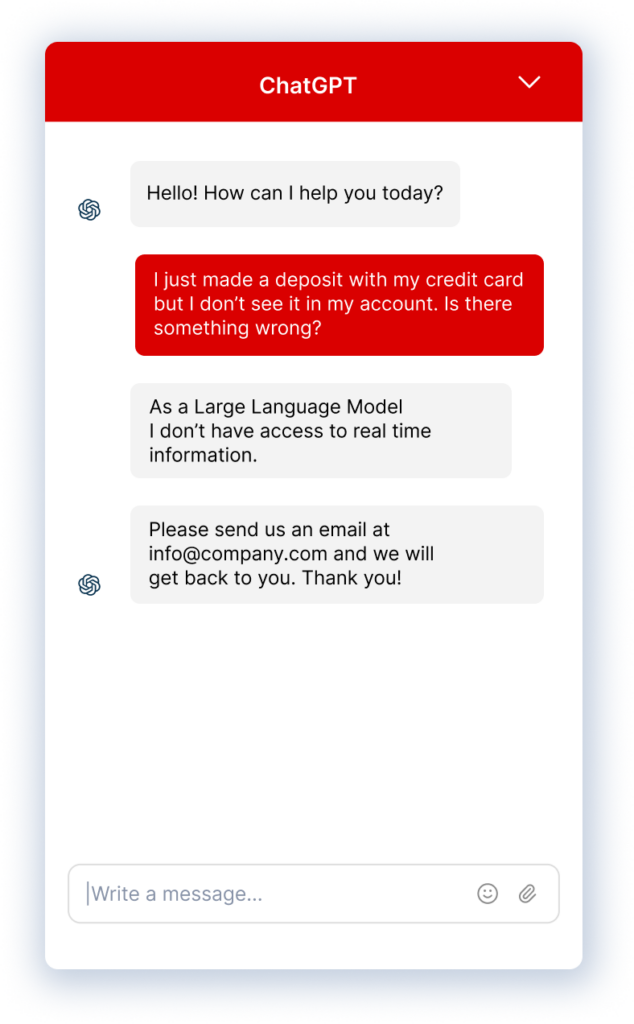

- Acesso a dados dinâmicos de APIs

Embora o GPT-4 seja excelente em responder perguntas gerais, ele não consegue resolver problemas específicos de negócios. O GPT-4 tem dificuldade em seguir instruções explícitas e não consegue se conectar de forma confiável a sistemas de terceiros. Consequentemente, as empresas consideram um desafio oferecer um atendimento ao cliente personalizado e personalizado, como responder a consultas relacionadas a pedidos em cenários de comércio eletrônico ou fornecer atualizações de status de transações em aplicativos Fintech.

Grandes modelos de linguagem hospedados de forma privada

O Llama-2 da Meta foi lançado em 2023, seguido por uma onda de LLM de código aberto que permite que empresas ou provedores de IA auto-hospedem LLMs em sua própria infraestrutura. Muitos laboratórios independentes de IA e algumas plataformas de IA conversacional, como Moveo.AI, começaram a treinar seus próprios LLMs proprietários usando outros LLMs de código aberto como base, como LLAMA-2 e Mistral. A diferença fundamental está em ter acesso a modelos de linguagem hospedados de forma privada — em vez de depender de APIs externas.

Os LLMs proprietários da Moveo são treinados especificamente para atendimento ao cliente em comércio eletrônico, Fintech e Gametech, trazendo o poder dos modelos de linguagem diretamente para a infraestrutura empresarial. Isto não só aumenta a velocidade de processamento, mas também concede às organizações maior controle sobre a privacidade e segurança dos dados. Embora a Moveo forneça uma oferta de nuvem com todas as garantias de privacidade e segurança de dados, também pode ser implementada em sistemas locais isolados para empresas que não permitem qualquer partilha de dados fora da sua própria infraestrutura.

Além das perguntas frequentes com automação de processos

Os benefícios dos modelos hospedados de forma privada vão muito além da mera eficiência. Moveo.AI capacita as empresas com soluções personalizadas, facilitando não apenas perguntas frequentes, mas também automação de processos em grande escala. Os casos de uso variam de insights em tempo real, analisando dados próprios, até interações personalizadas com o cliente, mostrando a adaptabilidade e versatilidade de LLMs hospedados de forma privada em um ambiente empresarial.

- Maior segurança, privacidade e conformidade

Preocupações primordiais, como segurança e conformidade, especialmente em setores regulamentados, são uma grande preocupação. A Moveo.AI aborda estas preocupações com diligência, garantindo que as organizações possam aproveitar o poder dos modelos de linguagem sem comprometer a integridade dos dados, oferecendo a opção de instalação no local.

- Personalization

Ao contrário do GPT-4 ou de outros modelos de terceiros, os LLMs da Moveo são afinados nas conversas de negócios, garantindo a máxima precisão nas informações fornecidas. Em vez de respostas genéricas longas, os LLMs da Moveo proporcionam uma experiência mais conversacional com perguntas de acompanhamento garantindo uma melhor experiência do cliente. Os modelos de linguagem da Moveo podem não só responder à maioria das perguntas dos utilizadores, mas também podem ligar-se de forma fiável a APIs externas para fornecer a melhor experiência personalizada ao cliente.

- Escalabilidade

Na maioria das aplicações empresariais de suporte ao cliente, existem acordos de nível de serviço (SLAs) para garantir um desempenho confiável dos agentes de IA no que diz respeito aos tempos de resposta e ao número de conversas simultâneas que podem suportar. Pela nossa experiência, a oferta padrão do GPT-4 não consegue atingir SLAs de nível empresarial, pois é muito lenta e não consegue lidar com uma grande carga de solicitações. A Moveo.AI, por outro lado, é capaz de lidar com picos inesperados de demanda, apoiando o crescimento empresarial. Do comércio eletrônico com Black Friday e Natal até GameTech e Copa do Mundo.

Leia mais: Moveo.AI vs GPT-4

Conclusão

O cenário de LLMs para aplicativos empresariais testemunhou uma jornada transformadora, desde modelos baseados em API, como GPT-4, até wrappers ChatGPT, como ChatBase, e modelos proprietários desenvolvidos por empresas como Moveo.AI. A escolha entre LLMs auto-hospedados e baseados em API depende das necessidades e prioridades exclusivas de cada empresa. Para que serão usados os LLMs na organização?

Em cenários onde a conformidade é de suma importância nas operações, a opção por LLMs proprietários torna-se imperativa. Esses modelos proprietários proporcionam maior controle sobre o tratamento de dados, oferecendo uma abordagem personalizada para enfrentar os desafios de conformidade únicos enfrentados pela organização. Por outro lado, para empresas que buscam uma implementação rápida de modelos pré-construídos para agilizar processos como automatizar perguntas frequentes simples, os wrappers ChatGPT oferecem uma solução pragmática. Esta abordagem, no entanto, pode ser considerada uma solução de curto prazo devido às suas preocupações de escalabilidade.